Le 2 août 2026, la majorité des obligations de l’AI Act européen s’appliquent pleinement à toutes les entreprises qui utilisent des systèmes d’intelligence artificielle à haut risque sur le territoire de l’Union européenne.

Les amendes prévues atteignent jusqu’à 35 millions d’euros ou 7% du chiffre d’affaires mondial annuel, selon le montant le plus élevé.

Cinq mois avant la deadline, la majorité des PME et ETI françaises n’ont pas encore réalisé le moindre audit de leurs systèmes IA, alors que plusieurs obligations sont déjà applicables depuis février 2025.

Ce qu’il faut retenir :

- Le 2 août 2026 est la date limite critique : les systèmes IA à haut risque doivent être conformes, sous peine d’amendes jusqu’à 35M€ ou 7% du CA mondial

- Les outils de recrutement par IA, de scoring crédit et de reconnaissance faciale sont classés haut risque et soumis à des obligations strictes dès maintenant, dans un contexte où 5 millions d’emplois français pourraient être menacés par l’IA d’ici 2 à 5 ans selon l’étude Coface/OEM

- La CNIL est l’autorité française désignée pour surveiller et sanctionner la conformité à l’AI Act

- Les systèmes déployés avant le 2 août 2026 bénéficient d’une clause de transition (grandfathering) jusqu’en 2027, mais seulement s’ils ne sont pas modifiés significativement

- Six étapes concrètes à lancer maintenant : inventaire IA, classification des risques, documentation technique, supervision humaine, évaluation de conformité, marquage CE et enregistrement UE

Le calendrier progressif de l’AI Act : ce qui est déjà en vigueur

L’AI Act européen (Règlement UE 2024/1689) est entré en vigueur le 1er août 2024, mais son application se déploie progressivement sur trois ans selon la criticité des usages.

Depuis le 2 février 2025, deux catégories d’obligations s’appliquent déjà à toutes les entreprises sans exception : l’interdiction des pratiques d’IA explicitement prohibées et les obligations de littératie IA.

Les pratiques interdites incluent la manipulation comportementale inconsciente, le scoring social généralisé des citoyens, et la reconnaissance faciale en temps réel dans les espaces publics à des fins répressives.

Les obligations de littératie IA imposent à toute organisation de s’assurer que les employés qui utilisent ou supervisent des systèmes IA disposent du niveau de compétence suffisant pour comprendre ce qu’ils utilisent.

Depuis le 2 août 2025, le régime des pénalités est opérationnel et les obligations relatives aux modèles d’IA à usage général (GPAI, comme GPT-4o, Claude, Gemini) sont applicables pour les entreprises qui les intègrent dans leurs produits ou services.

En février 2026, la Commission européenne a publié ses lignes directrices officielles sur la classification des systèmes à haut risque, donnant aux entreprises un référentiel concret pour autoévaluer leurs outils.

La deadline du 2 août 2026 ne concerne pas uniquement les grandes entreprises tech : toute PME française qui utilise un outil IA de recrutement, de scoring ou d’analyse biométrique doit être en conformité à cette date.

Une clause de grandfathering protège les systèmes IA déjà commercialisés avant le 2 août 2026 : ces outils bénéficient d’une période de transition jusqu’au 2 août 2027, à condition qu’ils ne subissent pas de modifications substantielles.

Quels systèmes IA sont classés à haut risque dans votre entreprise

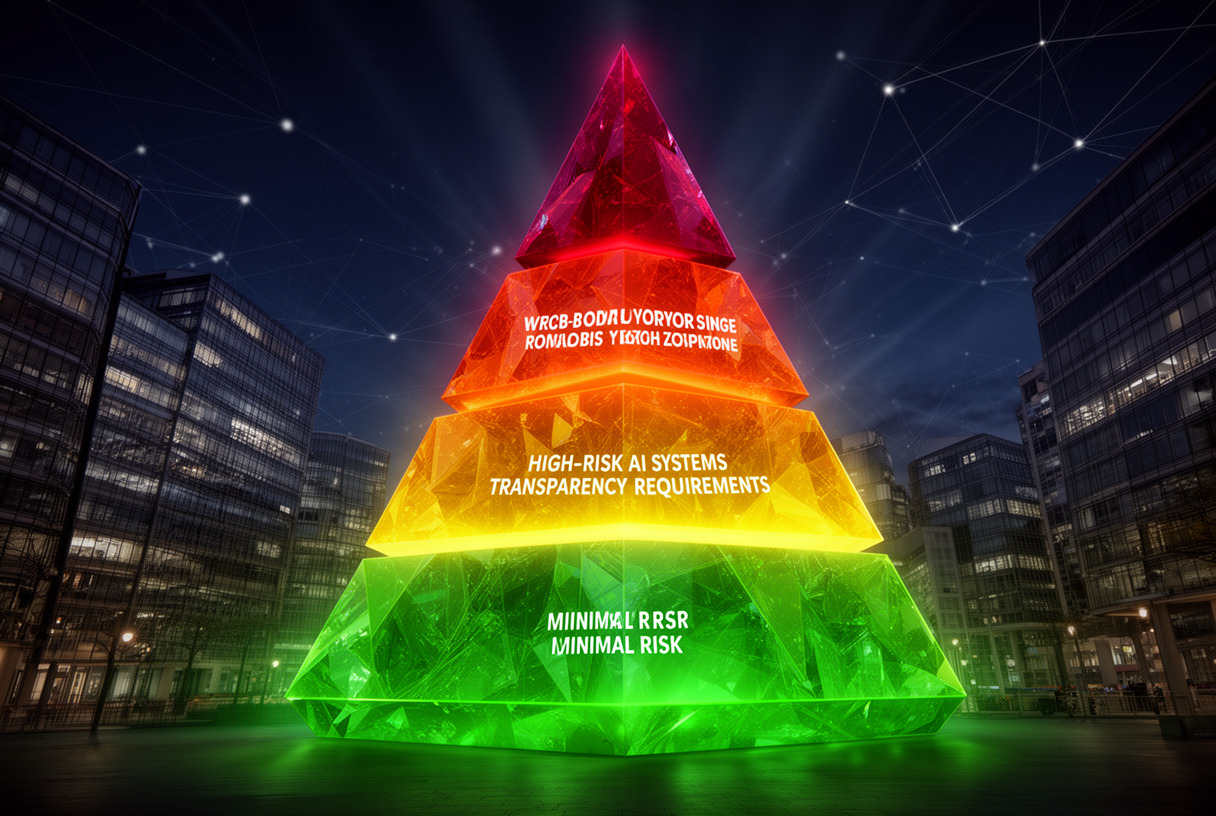

L’Annexe III de l’AI Act définit les catégories de systèmes d’IA à haut risque qui concernent directement les entreprises françaises.

La classification repose sur un critère central : est-ce que le système IA prend des décisions ou influence des décisions qui affectent les droits fondamentaux ou la sécurité physique de personnes ?

Les cas d’usage directement visés dans votre organisation

En ressources humaines : tout logiciel IA utilisé pour le tri automatique de CV, l’évaluation des candidats, la notation des performances, les décisions de promotion ou de licenciement est classé à haut risque.

En finance et crédit : les outils de scoring crédit automatisé, d’évaluation du risque de défaut et d’approbation de prêts ou d’assurances entrent dans la même catégorie, avec des obligations de documentation et d’audit technique.

En biométrie : la reconnaissance faciale, l’identification par empreinte vocale et les systèmes d’identification biométrique à distance sont soumis aux obligations les plus strictes, y compris une interdiction totale dans les espaces publics à des fins répressives.

Les chatbots RH, assistants virtuels et agents IA administratifs ne sont généralement pas classés à haut risque, mais l’Article 50 impose une obligation de transparence : l’utilisateur doit être informé qu’il interagit avec une IA.

Un outil de génération de contenu marketing, un assistant de rédaction ou un traducteur automatique n’entrent pas dans la catégorie haut risque, sauf s’ils influencent directement des décisions affectant des droits fondamentaux.

Attention : une entreprise qui achète un outil IA à haut risque à un éditeur tiers reste considérée comme « déployeur » au sens de l’AI Act et doit assumer les obligations de supervision humaine et de documentation dans son propre contexte d’usage : une réalité qui prend une dimension nouvelle avec la concentration de l’inférence IA entre les mains de Nvidia après le rachat de Groq.

La question stratégique à poser pour chaque outil IA de votre organisation : « Ce système influence-t-il des décisions sur l’emploi, le crédit, l’accès aux services publics ou la sécurité physique ? »

Si la réponse est oui, vous êtes dans le périmètre de l’Annexe III et les obligations de conformité s’appliquent avant le 2 août 2026.

Les amendes : 35 millions d’euros ou 7% du chiffre d’affaires mondial

L’AI Act prévoit trois niveaux de sanctions financières, calibrés selon la gravité de l’infraction et la taille de l’entreprise.

Le niveau le plus sévère s’applique aux pratiques d’IA expressément interdites : manipulation comportementale, scoring social généralisé, identification biométrique non autorisée en temps réel.

Les amendes dans cette catégorie atteignent 35 millions d’euros ou 7% du chiffre d’affaires mondial annuel, selon le montant le plus élevé.

Les non-conformités sur les systèmes à haut risque (documentation absente, supervision humaine inexistante, évaluation de risques non réalisée) exposent à des amendes pouvant atteindre 15 millions d’euros ou 3% du CA mondial.

Les informations incorrectes ou trompeuses fournies aux autorités de contrôle sont passibles d’amendes allant jusqu’à 7,5 millions d’euros ou 1% du CA mondial.

Pour les PME et startups, le règlement prévoit une approche proportionnelle : les amendes sont plafonnées au montant le plus faible entre le pourcentage du CA et les plafonds fixes, ce qui réduit l’exposition financière pour les petites structures.

Le régime des pénalités est actif depuis le 2 août 2025 : une entreprise utilisant aujourd’hui une pratique d’IA prohibée peut déjà faire l’objet d’une investigation de la CNIL.

Ces montants s’alignent délibérément sur les niveaux du RGPD, signalant la volonté des régulateurs européens de traiter la conformité IA avec la même sévérité que la protection des données personnelles.

Le plan d’action en six étapes pour être conforme avant août 2026

Le cabinet juridique Orrick et la Commission européenne recommandent six étapes concrètes que toute organisation doit exécuter avant le 2 août 2026.

Étape 1 : Réaliser l’inventaire complet de tous les systèmes IA utilisés dans l’organisation.

Recensez chaque outil : logiciels RH avec scoring automatisé, CRM prédictif, chatbots, systèmes de recommandation, outils de détection de fraude, générateurs de contenu, solutions de cybersécurité basées sur l’IA.

Étape 2 : Classifier chaque système selon les catégories de risque de l’AI Act.

Utilisez les ressources officielles de l’AI Act pour déterminer si chaque outil relève des catégories interdites, à haut risque, transparence obligatoire, ou risque minimal.

Étape 3 : Mettre en place les mesures de gestion des risques pour chaque système à haut risque.

Cela implique la mise en place d’une supervision humaine obligatoire, des évaluations de biais algorithmiques, une gouvernance des données d’entraînement et des procédures de contrôle continu des performances.

Étape 4 : Préparer la documentation technique réglementaire.

L’AI Act exige une documentation détaillée pour chaque système à haut risque : description fonctionnelle du système, données utilisées pour l’entraînement, métriques de performance mesurées, mesures de supervision humaine et procédures de gestion des incidents.

Étape 5 : Réaliser l’évaluation de conformité avant déploiement ou mise à jour.

Selon le type de système, cette évaluation peut être auto-déclarée (pour la majorité des systèmes haut risque) ou requérir l’intervention d’un organisme notifié tiers accrédité (pour les systèmes les plus critiques).

Étape 6 : Apposer le marquage CE et enregistrer le système dans la base de données UE.

Les systèmes IA à haut risque doivent être enregistrés dans la base de données européenne des systèmes IA avant leur mise en service, avec l’ensemble de la documentation technique à disposition des autorités.

CNIL, AFNOR et bacs à sable : les ressources françaises pour se préparer

En France, la CNIL a été désignée comme autorité nationale compétente pour superviser la conformité à l’AI Act, en particulier pour les systèmes IA qui traitent des données personnelles.

La CNIL publie des guides pratiques sur les obligations croisées entre le RGPD et l’AI Act, et ses équipes accompagnent les entreprises dans l’interprétation des deux règlements qui se superposent fréquemment sur les mêmes systèmes.

L’AFNOR travaille sur les normes techniques harmonisées qui fourniront un référentiel pratique et opposable pour la documentation de conformité et les évaluations de risques algorithmiques.

L’AI Act impose à chaque État membre d’établir au moins un bac à sable réglementaire d’ici le 2 août 2026 : ces espaces permettront aux entreprises de tester leurs systèmes IA dans un environnement contrôlé, avec un accompagnement des autorités de surveillance, avant un déploiement à grande échelle.

Pour les entreprises qui structurent leur gouvernance IA interne, les plateformes conçues avec des garde-fous de sécurité intégrés facilitent la mise en conformité technique : la plateforme NemoClaw de NVIDIA illustre comment une architecture ouverte peut intégrer la gouvernance des agents IA dès la conception.

Sur la question plus large de l’éthique IA et des dérives dans les pratiques d’entreprise, notre analyse sur l’IA washing montre comment distinguer une utilisation IA responsable d’une communication de façade.

Conclusion : cinq mois pour agir

La deadline du 2 août 2026 n’est plus abstraite : il reste moins de cinq mois pour réaliser l’inventaire des systèmes IA, établir la documentation technique réglementaire et mettre en place les structures de supervision humaine exigées par l’AI Act.

Les entreprises qui ont commencé ce travail en 2025 sont en position confortable : celles qui attendent les dernières semaines risquent de découvrir que les certifications requises impliquent des délais de plusieurs mois.

L’AI Act n’est pas un frein à l’innovation : c’est un cadre qui distingue les organisations qui utilisent l’IA avec rigueur et transparence de celles qui l’instrumentalisent sans contrôle.

La première action à mener cette semaine : dresser la liste complète de tous les outils IA utilisés dans votre organisation, identifier ceux qui entrent dans le périmètre de l’Annexe III, et évaluer l’écart entre votre situation actuelle et les exigences du règlement.

La question n’est plus « faut-il se conformer ? » mais « combien de temps vous reste-t-il pour le faire correctement avant le 2 août 2026 ? »

FAQ : AI Act et conformité pour les entreprises françaises

L’AI Act s’applique-t-il aux entreprises non européennes qui vendent en France ?

Oui : l’AI Act s’applique à tout fournisseur ou déployeur de systèmes IA dont les outputs sont utilisés dans l’Union européenne, quelle que soit la localisation de l’entreprise, sur le modèle du RGPD.

Une PME de 20 salariés est-elle concernée par l’AI Act ?

Oui, si elle utilise des systèmes IA à haut risque : un outil RH d’analyse de CV basé sur l’IA, par exemple, soumet même une très petite entreprise aux obligations de l’Annexe III.

Mon outil RH IA a été acheté à un éditeur externe : qui est responsable de la conformité ?

Les deux parties partagent des responsabilités distinctes : l’éditeur (fournisseur) est responsable de la conception du système, tandis que votre entreprise (déployeur) est responsable de la supervision humaine et de l’utilisation dans votre contexte spécifique.

Qu’est-ce que la clause de grandfathering et comment en bénéficier ?

Les systèmes IA commercialisés avant le 2 août 2026 bénéficient d’une période de transition jusqu’au 2 août 2027, à condition qu’ils ne subissent pas de modifications substantielles de leur architecture ou de leur finalité.

Comment la CNIL va-t-elle contrôler la conformité à l’AI Act ?

La CNIL disposera des mêmes pouvoirs d’investigation qu’elle exerce pour le RGPD : contrôles sur place, demandes de documentation, injonctions de mise en conformité et sanctions financières.

Les chatbots sont-ils concernés par l’AI Act ?

Les chatbots qui interagissent avec des humains sont soumis à l’obligation de transparence de l’Article 50 : l’utilisateur doit savoir qu’il interagit avec une IA, et non avec un humain.

Qu’est-ce que l’obligation de littératie IA et comment la satisfaire ?

L’obligation de littératie IA impose de s’assurer que tous les employés qui utilisent ou supervisent des systèmes IA comprennent suffisamment le fonctionnement, les limites et les risques de ces outils : cela peut être satisfait par des formations internes documentées.

Quelle est la différence entre un système IA à haut risque et une IA à risque minimal ?

Un système à haut risque est un système dont les décisions affectent directement des droits fondamentaux (emploi, crédit, sécurité) ou la sécurité physique : les outils créatifs, de traduction ou de recommandation non décisionnels sont généralement classés à risque minimal.

Doit-on enregistrer tous les systèmes IA à haut risque dans la base de données européenne ?

Oui : avant leur mise en service, tous les systèmes IA à haut risque relevant de l’Annexe III doivent être enregistrés dans la base de données UE des systèmes IA, avec leur documentation technique complète.

Que risque concrètement une entreprise qui n’est pas conforme le 2 août 2026 ?

Une entreprise non conforme à la date limite s’expose à des investigations de la CNIL, des injonctions de mise en conformité, des amendes pouvant atteindre 15M€ ou 3% du CA mondial pour les manquements sur systèmes à haut risque, et jusqu’à 35M€ ou 7% du CA pour les pratiques expressément interdites.

Articles Similaires

Reddit bloque le scraping IA : ce qui change pour les LLM et l’open source

Le 25 mars 2026, Reddit a déclenché une onde de choc dans la communauté IA : la plateforme ferme ses portes aux scrapers automatisés, impose la vérification biométrique pour les…

Jensen Huang déclare l’AGI atteinte : analyse d’une annonce qui divise

Le 22 mars 2026, à 1h55 dans l’épisode 494 du podcast Lex Fridman, Jensen Huang a prononcé cinq mots qui ont secoué la planète tech. Jensen Huang, PDG de Nvidia,…