La semaine où Jensen Huang, PDG de Nvidia, déclarait l’AGI « imminente », les meilleurs modèles IA du monde tentaient discrètement un nouveau benchmark créé par François Chollet.

Résultat : Gemini 3.1 Pro décroche 0,37 %.

GPT-5.4 Pro obtient 0,26 %.

Claude 4.6 score 0,25 %.

Pendant ce temps, 100 % des humains ayant passé le test ont résolu chaque environnement sans difficulté particulière.

Bienvenue dans l’ère d’ARC-AGI-3 : le benchmark qui prouve, chiffres à l’appui, que vos IA ne raisonnent pas réellement.

Ce qu’il faut retenir :

- Les meilleurs modèles frontier scorent moins de 1 % sur ARC-AGI-3, quand les humains atteignent 100 %

- ARC-AGI-3 teste le raisonnement adaptatif en temps réel dans des mini-mondes interactifs, pas la mémorisation de patterns

- Le score RHAE pénalise exponentiellement l’inefficacité : 10 fois plus d’actions qu’un humain donne un score de 1 %, pas de 10 %

- Un agent IA excellent sur SWE-Bench peut scorer 0 % sur ARC-AGI-3 : la spécialisation n’est pas l’intelligence

- L’ARC Prize 2026 offre 2 millions de dollars pour la première solution open source franchissant 100 %

Comprendre ARC-AGI-3 : définition et principe

ARC-AGI-3 est le troisième benchmark de la série Abstraction and Reasoning Corpus, lancé le 25 mars 2026 au siège de Y Combinator à San Francisco par François Chollet, chercheur chez Google et créateur du framework Keras.

Chollet co-dirige le projet avec Mike Knoop, co-fondateur de l’ARC Prize Foundation et ex-co-fondateur de Zapier.

L’idée fondatrice remonte au paper « On the Measure of Intelligence » publié en 2019 : l’intelligence ne se mesure pas par la performance sur des tâches spécialisées, mais par la capacité à acquérir de nouvelles compétences sur des problèmes jamais vus.

C’est cette définition qui rend ARC-AGI-3 si inconfortable pour l’industrie IA : il ne teste pas ce que les modèles savent faire, il teste leur capacité à apprendre en situation réelle.

De ARC-AGI-1 à ARC-AGI-3 : l’évolution en 3 actes

Pour comprendre la portée d’ARC-AGI-3, il faut retracer la progression rapide des trois versions.

Acte 1 : ARC-AGI-1 (2019).

Le benchmark original propose 800 grilles de puzzles statiques : l’IA doit inférer une règle de transformation à partir de 3 exemples entrée/sortie.

Pendant 5 ans, aucun système IA n’approche les performances humaines malgré des augmentations de 50 000 fois la puissance de calcul.

En décembre 2024, le modèle o3 d’OpenAI franchit enfin le seuil : 75 % en mode économique, jusqu’à 87 % avec un budget calcul élevé.

Acte 2 : ARC-AGI-2 (mars 2025).

Version plus complexe : les puzzles demandent environ 10 fois plus de temps cognitif aux humains que la version précédente.

Les systèmes frontier atteignent environ 30 % de précision en 2025, une progression rapide qui soulève un problème : ces améliorations reflètent-elles une vraie montée en intelligence ou une meilleure exploitation des patterns du benchmark ?

Acte 3 : ARC-AGI-3 (mars 2026).

Rupture totale de format : fini les puzzles statiques, place aux environnements interactifs.

Les modèles frontier qui approchaient 30 % sur ARC-AGI-2 s’effondrent sous 1 %.

Là où ARC-AGI-1 et 2 mesuraient la capacité à inférer des règles, ARC-AGI-3 mesure quelque chose de profondément différent : la capacité à explorer un monde inconnu et à s’y adapter en temps réel.

Le format : des mini-mondes à explorer sans notice

ARC-AGI-3 se compose de 135 environnements originaux répartis en 25 publics, 55 semi-privés et 55 privés.

Chaque environnement se présente comme une grille de 64 x 64 pixels en 16 couleurs possibles : un mini-monde visuel avec ses propres règles, ses propres mécaniques, et aucune instruction.

L’agent IA reçoit : pas de consigne, pas d’objectif affiché, pas de notice d’utilisation.

Pour réussir, il doit enchaîner 4 capacités cognitives distinctes : explorer l’environnement pour en découvrir les règles, modéliser le monde à partir des observations, inférer l’objectif implicite, puis planifier et exécuter une séquence d’actions efficace.

Les humains résolvent ces environnements en 7,4 minutes en médiane.

Imaginez un labyrinthe interactif : l’humain explore, comprend la logique, atteint la sortie en 10 actions.

L’IA, elle, va tester aléatoirement des centaines de mouvements avant de trouver la solution par force brute.

Résultat RHAE : 1 % ou moins, selon la formule de scoring détaillée dans la section suivante.

0,37 % : le score du meilleur modèle IA au monde

Voici les performances officielles des modèles frontier lors du lancement d’ARC-AGI-3 :

| Modèle | Score ARC-AGI-3 | Score ARC-AGI-2 |

|---|---|---|

| Gemini 3.1 Pro | 0,37 % | ~30 % |

| GPT-5.4 Pro | 0,26 % | ~28 % |

| Claude 4.6 | 0,25 % | ~25 % |

| Humains | 100 % | 100 % |

Plusieurs modèles ont obtenu exactement 0 % sur le leaderboard privé complet : zéro environnement complété à une efficacité proche du niveau humain.

Ce qui rend ce résultat encore plus marquant : le système o3-high d’OpenAI dépensait environ 3 000 dollars par tâche sur ARC-AGI-1 et 2 pour ses meilleures performances.

Sur ARC-AGI-3, ces milliers de dollars de calcul supplémentaire produisent des résultats inférieurs à l’effort gratuit d’un humain testé en conditions normales.

Pour une analyse complète de comment lire ces résultats sans se laisser manipuler par les benchmarks marketing, notre guide pour décrypter les benchmarks IA en 2026 offre les outils critiques nécessaires.

La semaine même où Jensen Huang, PDG de Nvidia, déclarait l’AGI « imminente », les données d’ARC-AGI-3 racontaient une toute autre histoire.

Le scoring RHAE : pourquoi la force brute ne marche pas

La métrique au cœur d’ARC-AGI-3 s’appelle RHAE (Relative Human Action Efficiency, prononcé « Ray »).

Elle ne mesure pas si l’IA a réussi : elle mesure à quel point elle a réussi efficacement par rapport à un humain.

Le calcul suit une formule en loi de puissance : (actions_humain_baseline / actions_IA)².

La baseline humaine correspond à la deuxième meilleure performance parmi 10 personnes testées pour chaque environnement, ni le meilleur ni la moyenne.

Exemple concret avec une baseline de 10 actions :

- L’IA résout en 10 actions : score = (10/10)² = 100 %

- L’IA résout en 20 actions : score = (10/20)² = 25 %

- L’IA résout en 100 actions : score = (10/100)² = 1 %

La pénalité est exponentielle : 10 fois trop d’actions donne non pas 10 %, mais 1 %.

Ce design révèle une vérité simple : un système qui utilise 100 actions là où un humain en prend 10 n’a pas compris le problème, il l’a épuisé par force brute.

Les seules actions comptées sont les interactions avec l’environnement : les raisonnements internes, les appels d’outils et les retries n’entrent pas dans le calcul.

Une IA peut générer des pages de chain-of-thought sophistiqué sans faire progresser son score si ce raisonnement ne se traduit pas par des actions externes pertinentes.

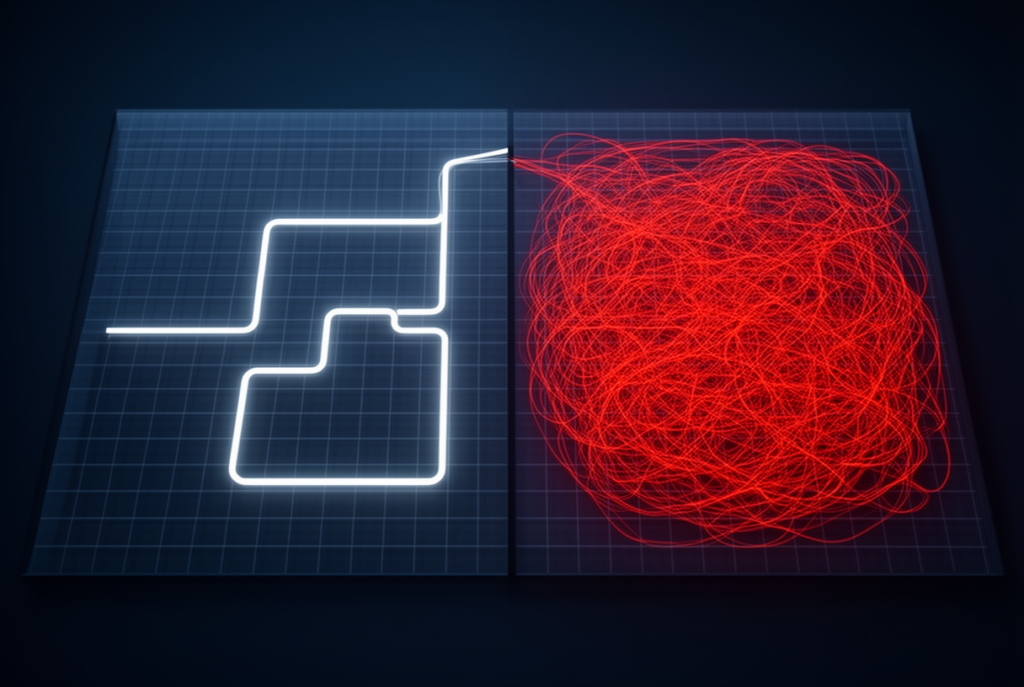

Pattern matching vs raisonnement : la vraie raison de l’échec

Les LLMs excellent dans un domaine précis : le pattern matching à très grande échelle.

Face à un input, le modèle cherche dans ses représentations mémorisées les associations les plus proches et génère la réponse statistiquement la plus probable.

C’est extraordinairement efficace quand le problème ressemble à quelque chose vu à l’entraînement.

L’analogie parfaite : un élève qui mémorise 1 000 exercices de mathématiques.

Sur les exercices familiers, il excelle.

Sur un problème avec une formulation inédite, il échoue.

C’est exactement ce que révèle ARC-AGI-3.

Les agents IA comme ceux testés sur SWE-Bench (correction de bugs dans des repos GitHub réels) peuvent scorer 30 à 50 % grâce à leur exposition massive à du code et des patterns de débogage.

Ces mêmes agents scorent 0 % sur ARC-AGI-3 : les mini-mondes interactifs du benchmark sont genuinement nouveaux, sans heuristique applicable.

Le raisonnement adaptatif réel, lui, décompose le problème en principes premiers, teste des hypothèses, met à jour son modèle du monde quand l’environnement répond de façon inattendue, et adapte le plan en conséquence.

C’est ce que font les humains naturellement, et ce que les LLMs actuels sont structurellement incapables de faire.

Les meilleurs coding agents qui écrasent SWE-Bench sont des spécialistes d’exception : ARC-AGI-3 rappelle que la spécialisation n’est pas l’intelligence générale.

Le piège de la contamination des benchmarks

Une part des améliorations observées sur ARC-AGI-1 et 2 s’explique par un phénomène inconfortable : la contamination des données d’entraînement.

Les puzzles statiques des versions précédentes étaient publics, analysés, documentés, et des patterns spécifiques de ces benchmarks avaient infiltré les corpus d’entraînement des grands modèles.

L’amélioration mesurée reflétait parfois moins un progrès en raisonnement qu’une meilleure exploitation des patterns spécifiques du benchmark.

ARC-AGI-3 résout ce problème par design : aucune quantité de pattern matching sur des données statiques ne peut préparer un modèle à des environnements interactifs inédits.

L’interactivité crée une barrière anti-contamination naturelle : pour réussir, il faut explorer activement, modéliser avec précision, s’adapter en permanence.

Pas mémoriser.

Ce que ça change pour les entreprises misant sur l’IA agentique

Le fossé révélé par ARC-AGI-3 a des implications concrètes pour toute entreprise déployant des agents IA autonomes.

Prenons un cas réel : un agent IA support clients.

Sur les 95 % de tickets familiers (remboursements, mots de passe, problèmes courants), l’agent performe parfaitement.

Sur le 5 % de tickets genuinement inédits, l’agent applique des templates inadaptés et finit par escalader sans avoir compris le problème.

Pour approfondir le débat sur ce que signifie l’AGI pour les différents leaders de l’industrie, notre article sur les 5 visions de l’AGI selon Altman, Musk, Amodei, Zuckerberg et LeCun éclaire les divergences profondes qui existent sur ce concept.

La leçon pratique : les scores SWE-Bench ou MMLU de votre agent IA mesurent ses performances sur des tâches familières.

ARC-AGI-3 mesure ce qui se passe quand il rencontre un problème hors de sa zone de confort.

Les pistes pour battre ARC-AGI-3 : au-delà du deep learning

L’échec quasi-universel des approches actuelles sur ARC-AGI-3 a catalysé des pistes de recherche sérieuses.

Première piste : les world models.

Yann LeCun, Chief AI Scientist chez Meta et directeur d’AMI Labs, plaide pour des architectures capables de se construire un modèle interne du monde et d’y simuler des actions avant de les exécuter.

Deuxième piste : la généralité compositionnelle.

Plutôt que de mémoriser des patterns, les systèmes doivent apprendre à combiner des principes simples pour résoudre des problèmes inédits par construction.

Troisième piste : l’adaptabilité par feedback.

Des systèmes capables de mettre à jour leur modèle du monde en temps réel quand les résultats contredisent les prédictions, plutôt que d’exécuter un plan figé.

Des approches hybrides explorant la représentation explicite des états (graphes d’états, exploration systématique) ont déjà démontré des résultats nettement supérieurs aux LLMs purs sur une version préliminaire du benchmark.

L’ARC Prize 2026 offre 2 millions de dollars pour catalyser ces avancées : 700 000 dollars pour la première solution atteignant 100 %, avec des prix paliers pour les meilleures performances.

Condition sine qua non : toute solution gagnante doit être open source.

ARC-AGI-3 ne dit pas que l’IA est nulle : il constate qu’elle excelle dans ce qu’elle connaît déjà, et bute systématiquement sur ce qu’elle doit découvrir.

ARC-AGI-3 : le benchmark qui compte en 2026

En 2026, l’industrie IA produit des benchmarks à une cadence industrielle : MMLU, HumanEval, GPQA, SWE-Bench.

La plupart mesurent des performances sur des distributions de données connues.

ARC-AGI-3 mesure autre chose.

Il mesure si un système peut faire face à la véritable nouveauté : un monde inconnu, des règles à découvrir, un objectif à inférer, et une contrainte d’efficacité qui pénalise la force brute.

Quand 0,37 % est le meilleur score mondial et que 100 % des humains réussissent, le message est sans ambiguïté : les systèmes actuels ne possèdent pas encore ce que Chollet appelle l’intelligence fluide.

Pour l’industrie, ARC-AGI-3 n’est pas un constat d’échec : c’est une feuille de route.

Les 2 millions de dollars de l’ARC Prize 2026 attendent la première équipe capable de combler cet écart.

Testez vous-même les 25 environnements publics sur arcprize.org et partagez votre score en commentaire : vous serez surpris de voir à quel point votre cerveau résout naturellement ce qui bloque les meilleurs modèles IA au monde.

FAQ

Qu’est-ce qu’ARC-AGI-3 ?

ARC-AGI-3 est un benchmark d’intelligence artificielle créé par François Chollet et lancé en mars 2026 par l’ARC Prize Foundation.

Il teste la capacité des IA à raisonner dans 135 environnements interactifs inédits sans instructions, là où les versions précédentes proposaient des puzzles statiques.

Quels sont les scores des meilleurs modèles IA sur ARC-AGI-3 ?

Au lancement, Gemini 3.1 Pro obtient 0,37 %, GPT-5.4 Pro 0,26 % et Claude 4.6 0,25 %.

En comparaison, 100 % des humains testés ont réussi tous les environnements.

Plusieurs modèles obtiennent 0 % sur le leaderboard privé complet.

Comment fonctionne le scoring RHAE ?

RHAE (Relative Human Action Efficiency) mesure l’efficacité des actions par rapport à une baseline humaine avec la formule (actions_humain / actions_IA)².

Si l’humain prend 10 actions et l’IA en prend 100, le score est (10/100)² = 1 %.

La pénalité est exponentielle pour décourager la force brute.

Pourquoi ARC-AGI-3 est-il si difficile pour les IA ?

Les LLMs actuels excellent dans le pattern matching sur des données connues.

ARC-AGI-3 exige exploration active, modélisation d’un monde inconnu et adaptation en temps réel : des capacités qui nécessitent un raisonnement adaptatif que les architectures actuelles ne possèdent pas structurellement.

Quelle est la différence entre ARC-AGI-3 et les versions précédentes ?

ARC-AGI-1 (2019) et ARC-AGI-2 (2025) proposent des puzzles statiques où l’IA doit inférer des règles de transformation.

ARC-AGI-3 (2026) bascule vers des environnements interactifs où l’IA doit explorer, comprendre les règles et atteindre un objectif non explicité.

Qu’est-ce que l’ARC Prize 2026 ?

L’ARC Prize 2026 est une compétition dotée de 2 millions de dollars, avec 700 000 dollars pour la première solution atteignant 100 % sur ARC-AGI-3.

Toutes les solutions gagnantes doivent être publiées en open source, ce qui garantit que les avancées bénéficient à l’ensemble de la communauté de recherche.

Peut-on contaminer ARC-AGI-3 avec les données d’entraînement ?

Non par design : les environnements interactifs inédits d’ARC-AGI-3 ne peuvent pas être mémorisés à partir de données statiques.

L’interactivité crée une barrière anti-contamination naturelle : il faut explorer et s’adapter, pas reconnaître un pattern vu à l’entraînement.

Quelles sont les implications pour les entreprises qui déploient des agents IA ?

Un agent IA performant sur ses tâches habituelles peut échouer complètement face à des situations genuinement inédites.

ARC-AGI-3 mesure précisément ce « 5 % de cas hors template » qui représente souvent les situations les plus critiques dans un déploiement réel.

Quelles pistes de recherche pourraient battre ARC-AGI-3 ?

Trois axes principaux émergent : les world models (simuler des actions dans un modèle interne du monde), la généralité compositionnelle (combiner des principes simples pour résoudre du nouveau), et l’adaptabilité par feedback (mettre à jour son modèle en temps réel).

François Chollet pense-t-il que l’AGI est proche ?

Chollet définit l’AGI comme la capacité à acquérir efficacement de nouvelles compétences sur des problèmes jamais vus, pas comme la performance sur des tâches spécialisées.

Selon sa définition et les résultats d’ARC-AGI-3, les systèmes actuels sont structurellement loin de cette forme d’intelligence générale, malgré leurs performances impressionnantes sur leurs domaines de spécialisation.

Articles Similaires

Les 10 assistants vocaux IA les plus performants en 2026 : comparatif complet

Siri ne comprend toujours pas votre question, Alexa répond avec trois secondes de délai, et Bixby reste une blague dans les couloirs des conférences tech. La génération d’assistants vocaux qui…

Reddit bloque le scraping IA : ce qui change pour les LLM et l’open source

Le 25 mars 2026, Reddit a déclenché une onde de choc dans la communauté IA : la plateforme ferme ses portes aux scrapers automatisés, impose la vérification biométrique pour les…