Vous regardez une vidéo : un homme politique annonce sa démission, un PDG demande un virement urgent à son équipe, une célébrité recommande un placement financier douteux.

Ce que vous voyez n’existe pas : le visage et la voix sont entièrement générés par une IA, et votre cerveau en est convaincu.

Les deepfakes alimentent des fraudes à plusieurs millions de dollars, influencent des élections et détruisent des réputations : ce guide vous donne les clés pour comprendre la menace, identifier les indices visuels, et vous protéger efficacement.

Ce qu’il faut retenir :

- Les humains détectent les deepfakes avec 52 à 68 % de précision seulement, à peine au-dessus du hasard

- Reality Defender, Sensity AI et Intel FakeCatcher atteignent 70 à 96 % en production, mais restent imparfaits contre les deepfakes adversariaux

- La fraude au CFO via deepfake vidéo a coûté 25 millions de dollars à une entreprise de Hong Kong en 2024

- L’AI Act européen impose la transparence sur les contenus synthétiques dès août 2026

- Mains, dents et contours du visage restent les indices visuels les plus fiables sans outil spécialisé

- La meilleure défense : vérifier la source avant d’analyser le contenu

Comment fonctionnent les deepfakes en 2026

La technologie deepfake repose historiquement sur les réseaux antagonistes génératifs (GANs) : deux réseaux de neurones qui s’affrontent en boucle, l’un créant le contenu synthétique, l’autre tentant de le détecter.

En 2026, les GANs ont largement cédé la place aux modèles de diffusion, une approche qui construit le contenu par raffinement progressif et génère des vidéos 4K à 50 images par seconde avec synchronisation audio native, en quelques secondes sur un ordinateur grand public.

La barrière technique a pratiquement disparu : des applications comme DeepFaceLab proposent des interfaces aussi simples qu’un filtre de réseau social, sans la moindre compétence en programmation.

Pour la voix, des plateformes comme Fish Audio ou Resemble AI clonent un timbre vocal à partir de 10 à 30 secondes d’enregistrement seulement, contre 60 secondes minimum il y a deux ans.

Les trois étapes de fabrication d’un deepfake

La création suit un processus structuré en trois temps : collecte de données (photos, vidéos et enregistrements audio de la cible, piochés sur les réseaux sociaux), entraînement du modèle (l’IA apprend à reproduire le visage, la voix et les expressions), puis rendu (superposition du modèle sur une nouvelle vidéo ou génération complète).

Des outils comme OmniHuman illustrent l’état de l’art : convertir n’importe quelle photo en séquence vidéo animée avec des mouvements corporels et faciaux entièrement synthétiques, d’une cohérence troublante.

Un deepfake convaincant prend aujourd’hui moins de temps à créer qu’il n’en faut pour rédiger un email frauduleux : la menace n’est plus dans la sophistication technique, elle est dans l’accessibilité totale à n’importe qui.

La détection en 2026 : état réel des performances

Les chiffres publiés par les éditeurs d’outils de détection sont souvent flatteurs : la réalité de terrain l’est beaucoup moins.

Selon les évaluations indépendantes de 2025, un modèle affichant 96 % de précision en laboratoire peut tomber à 63 % face à de vrais deepfakes adversariaux, soit une précision inférieure à un tirage à pile ou face.

Pour les deepfakes audio, l’écart est encore plus sévère : des modèles passent d’une précision parfaite en labo à 43 % contre des contenus audio adversariaux réels.

Les humains, eux, détectent les deepfakes avec une précision de 52 à 68 % selon le type de média, et une étude de 2025 révèle que seuls 0,1 % des participants testés contre des contenus mélangés sont véritablement fiables.

Benchmark des cinq outils majeurs de détection

Reality Defender est l’une des rares solutions multimodales : il analyse simultanément les artefacts visuels, les patterns acoustiques, les métadonnées et les incohérences entre audio et vidéo, avec une précision de 70 à 85 % en production et des scores de confiance par zone analysée.

Sensity AI se positionne sur le forensique avec 98 % de précision revendiquée sur les datasets publics et des rapports adaptés aux procédures judiciaires, mais son temps d’analyse le rend inutilisable pour la détection en temps réel.

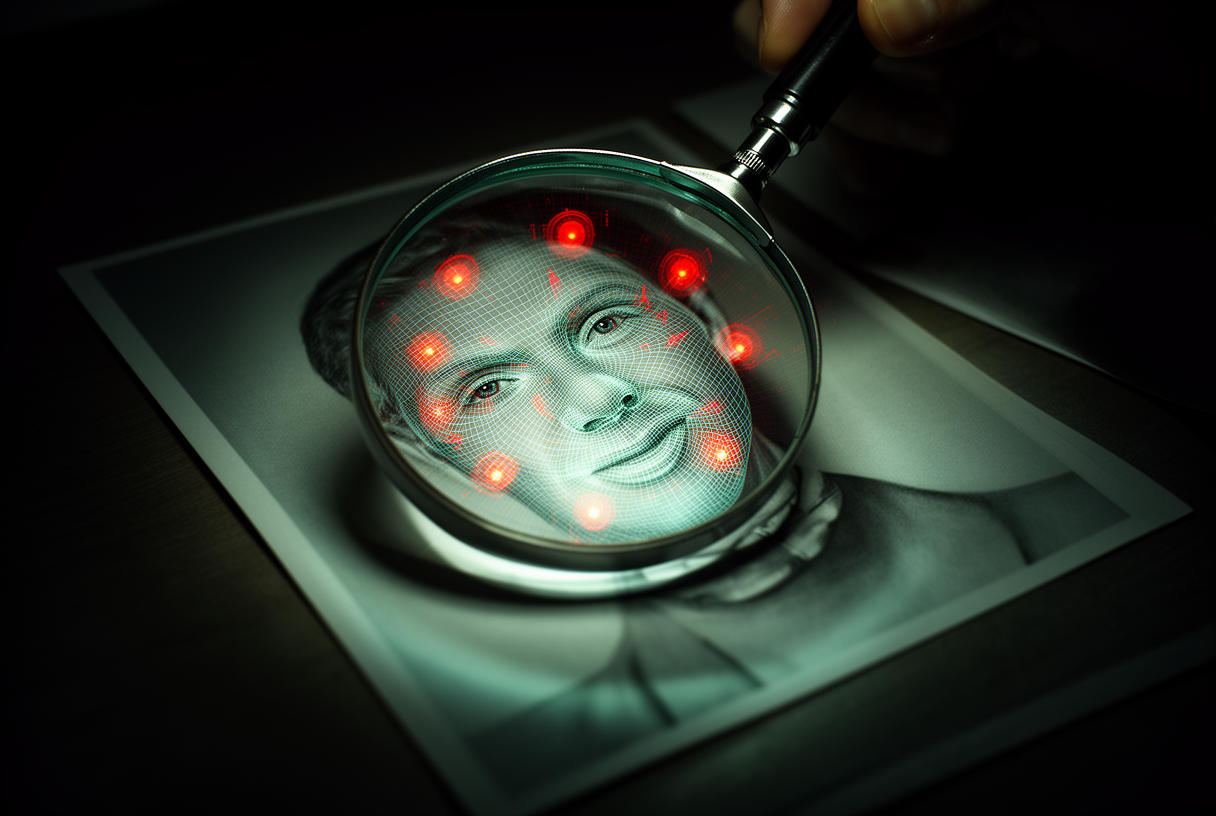

Microsoft Video Authenticator analyse chaque image d’une vidéo et retourne un score de probabilité de manipulation par zone du visage, avec chaque zone suspecte visuellement signalée pour les équipes de vérification.

Intel FakeCatcher adopte une approche radicalement différente : il détecte les variations de flux sanguin dans les pixels du visage, un signal biologique difficile à falsifier, atteignant 96 % de précision en laboratoire.

Pindrop Pulse, spécialisé en audio, atteint 99 % de précision en combinant la détection vocale avec son système d’authentification global, formé sur plus de 20 millions d’échantillons couvrant 370 systèmes de synthèse vocale différents.

Les systèmes adversariaux les plus récents contournent les détecteurs dans 78 à 99 % des cas lorsqu’ils sont spécifiquement conçus pour le faire : la course entre génération et détection n’est pas gagnée côté défenseurs.

Les cas réels documentés

Les deepfakes ont quitté le stade théorique : les impacts couvrent la fraude financière à grande échelle, la manipulation politique organisée et le harcèlement ciblé.

Fraude au CFO : 25 millions de dollars perdus à Hong Kong

En février 2024, un employé d’une multinationale basée à Hong Kong a autorisé un virement de 25 millions de dollars après avoir participé à une visioconférence deepfake impliquant plusieurs cadres simultanément, tous entièrement synthétiques.

Cette affaire marque un saut qualitatif majeur : les attaquants ne se contentent plus d’un seul participant deepfake, ils construisent des réunions entières de personnes synthétiques.

En 2019, une entreprise britannique perdait déjà 220 000 euros suite à un appel vocal deepfake imitant la voix du PDG avec suffisamment de fidélité pour convaincre le directeur de filiale d’exécuter le virement.

Élections et désinformation organisée

Lors des primaires démocrates du New Hampshire en 2024, des électeurs ont reçu des robocalls deepfake imitant Biden leur demandant explicitement de ne pas se rendre aux urnes.

En Irlande, lors de l’élection présidentielle 2025, une vidéo deepfake du candidat gagnant annonçant son retrait a circulé 48 heures avant le scrutin, accompagnée de prétendues confirmations de journalistes nationaux eux-mêmes deepfakés.

Les contenus politiques générés par IA se diffusent 90 % plus vite sur les réseaux sociaux que les contenus humains, selon les analyses du cycle électoral américain 2024.

Les campagnes municipales 2026 en France illustrent une tactique supplémentaire : accuser une vraie vidéo compromettante d’être un deepfake, sans même avoir besoin de produire le faux.

Comment repérer un deepfake sans outil spécialisé

Plusieurs zones du corps restent des points faibles persistants des générateurs d’images et de vidéos en 2026.

Les mains et les doigts sont les indices les plus fiables : doigts fusionnés, excédant cinq, à la courbure anatomiquement impossible, ou avec une texture de peau anormale aux articulations.

Les dents forment souvent un bloc blanc uniforme et lisse, sans la variation naturelle de couleur, d’espacement et d’irrégularité des vraies dents humaines.

Les contours du visage trahissent encore bien des deepfakes : flou anormal à la jonction entre la peau et les cheveux, distorsion lors des rotations de profil, oreilles qui disparaissent ou se déforment à 90 degrés.

Les yeux et les clignements restent un marqueur fiable : les humains clignent toutes les 2 à 10 secondes avec de légères contractions musculaires autour des yeux, là où les deepfakes clignent de façon mécanique ou pas du tout.

En vidéo, les micro-expressions sont coûteuses à simuler : un visage deepfake paraît souvent légèrement rigide, les émotions faciales décalées d’une fraction de seconde par rapport à la voix.

Pour l’audio : une voix clonée manque souvent de variation émotionnelle naturelle, les respirations tombent au mauvais moment syntaxique, et l’environnement sonore peut être incohérent avec le cadre visuel.

La recherche inversée d’images via Google Images, TinEye ou Yandex permet de vérifier si une image soi-disant fraîche est en réalité datée de plusieurs mois, invalidant immédiatement le contexte annoncé.

Les stratégies de protection efficaces

La règle la plus efficace pour les particuliers : ne jamais prendre de décision urgente sur la seule base d’un appel vidéo ou vocal, quelle que soit la qualité apparente de l’image ou du son.

Si un supérieur ou un proche demande une action sensible (virement, accès, décision rapide), rappeler sur un numéro connu de façon indépendante est le réflexe à ancrer.

Des solutions comme World ID représentent l’une des réponses émergentes pour prouver qu’un interlocuteur est un être humain réel, dans un contexte où les identités synthétiques deviennent indiscernables.

Pour les entreprises, la vérification multi-canal obligatoire est la mesure la plus efficace : toute demande impliquant une transaction financière ou un accès sensible doit être confirmée via un canal secondaire indépendant.

Les mots de code prédéfinis entre deux parties de confiance constituent une mesure simple et redoutablement efficace : un mot ou une phrase convenue uniquement entre elles, impossible à reproduire sans compromission préalable.

Limiter l’exposition publique de son visage, de sa voix et de ses photos sur les réseaux sociaux réduit les données d’entraînement disponibles pour créer un deepfake : précaution prioritaire pour les photos de mineurs.

La meilleure défense contre les deepfakes n’est pas technologique : c’est l’introduction délibérée de friction avant toute action urgente basée sur un contenu vidéo ou audio.

La régulation en 2026 : ce qui change concrètement

L’AI Act européen, applicable au 2 août 2026, impose des obligations de transparence explicites : l’article 50 exige que les outputs des systèmes IA soient marqués en format lisible par machine, et que les utilisateurs soient informés lorsqu’un contenu est artificiellement généré.

Cette régulation ne couvre que les deepfakes légaux : les contenus illégaux (pornographie non consentie, diffamation, fraude) relèvent d’autres corpus juridiques existants.

En France, la CNIL a précisé que des pratiques deepfake constituent déjà des infractions pénales sous le droit existant, avec des poursuites en cours contre des plateformes générant des contenus non consentis via leurs modèles d’IA.

En Italie, une loi de septembre 2025 criminalise la diffusion de deepfakes sans consentement avec des peines de 1 à 5 ans d’emprisonnement.

Au Royaume-Uni, la création de deepfakes intimes sans consentement est désormais un délit pénal depuis février 2026, avec un cadre d’évaluation des outils de détection co-développé avec Microsoft.

Aux États-Unis, le TAKE IT DOWN Act signé en mai 2025 impose aux plateformes de retirer les deepfakes non consentis dans les 48 heures suivant notification, avec obligation d’identifier et supprimer les duplicatas.

Quand s’inquiéter réellement

Les deepfakes méritent une vigilance sérieuse dans quatre contextes précis : les demandes financières urgentes reçues via vidéo ou appel, les contenus politiques chocs diffusés juste avant un scrutin, les communications intimes non sollicitées, et tout contenu incitant à une réaction immédiate sans source vérifiable.

L’overhype existe : la plupart des deepfakes viraux sont rapidement identifiés par les équipes de fact-checking, et les contenus les plus grossiers restent repérables à l’œil nu sans outil spécialisé.

Le vrai danger est souvent le « dividende du menteur » : la capacité à invoquer l’existence des deepfakes pour nier une vraie vidéo compromettante, avec une crédibilité croissante auprès du public.

Des recherches de l’université de Würzburg montrent que les politiciens qui nient une vraie vidéo scandaleuse en la qualifiant de deepfake sont perçus comme plus forts que ceux qui s’excusent, même lorsque la vidéo est authentique.

La meilleure immunité reste une culture de vérification systématique : questionner la source avant le contenu, attendre la confirmation par plusieurs médias de référence, et résister à la pression de l’urgence.

Conclusion

Les deepfakes occupent une zone intermédiaire que notre culture de l’information n’a pas encore pleinement intégrée : une menace sérieuse dans des contextes précis, surestimée dans d’autres.

La technologie de détection progresse, mais elle reste dans une course permanente avec la technologie de génération, avec un écart rarement en faveur des défenseurs.

Ce qui fonctionne aujourd’hui : le réflexe de vérification, la friction délibérée avant toute action urgente, et la conscience que nos instincts perceptifs ne sont plus des arbitres fiables.

Vous voyez une vidéo choquante : demandez-vous qui veut que vous croyiez cela, et pourquoi maintenant.

Vous avez déjà repéré un deepfake dans votre fil d’actualité ?

Partagez votre expérience en commentaire.

FAQ : deepfakes en 2026

Peut-on détecter un deepfake à l’œil nu

Oui, mais avec une fiabilité limitée : les humains réussissent dans 52 à 68 % des cas selon les études, et seuls 0,1 % des personnes testées sont fiables face à des contenus mélangés.

Les mains, les dents et les contours du visage restent les zones les plus révélatrices.

Les outils de détection sont-ils fiables en 2026

En laboratoire, les meilleurs outils affichent 94 à 98 % de précision.

En conditions réelles contre des deepfakes adversariaux, ce chiffre tombe à 63 à 85 % selon l’outil : aucune solution n’est infaillible face à des contenus conçus spécifiquement pour contourner la détection.

Quels sont les meilleurs outils de détection disponibles

Reality Defender (multimodal, 70 à 85 % en production), Sensity AI (forensique, 98 % en labo), Intel FakeCatcher (analyse du flux sanguin, 96 % en labo) et Pindrop Pulse (audio spécialisé, 99 %) figurent parmi les solutions les plus performantes selon leur contexte d’usage.

Les deepfakes audio sont-ils difficiles à détecter

Les deepfakes audio sont parmi les plus facilement détectables par les outils automatisés (84 à 89 % en production pour les meilleurs outils).

Les humains, eux, les détectent moins bien que les vidéos.

Les outils spécialisés comme Pindrop restent très efficaces dans ce domaine précis.

Comment protéger mon entreprise d’une fraude deepfake

Établissez un protocole de vérification multi-canal : toute demande sensible reçue par vidéo ou appel doit être confirmée via un canal secondaire indépendant.

Les mots de code prédéfinis entre parties de confiance constituent une mesure simple et très efficace pour les équipes financières.

Est-ce que créer un deepfake est illégal en France

La création seule relève d’un vide juridique relatif.

La diffusion de deepfakes à des fins de diffamation, de pornographie non consentie ou de fraude est pénalement réprimée sous les textes existants, et l’AI Act européen ajoute des obligations de transparence dès août 2026.

Les deepfakes peuvent-ils influencer une élection

Oui : les contenus IA se diffusent 90 % plus vite que les contenus humains sur les réseaux sociaux, et une étude Brookings estime que les deepfakes pourraient réduire la participation électorale de jusqu’à 7 % dans les scrutins serrés, soit un écart qui dépasse les marges de la plupart des scrutins serrés.

Les mineurs sont-ils exposés aux deepfakes

Oui : les deepfakes intimes ciblant des mineurs ont plus que doublé en 18 mois selon le rapport 2025 de l’eSafety Commissioner australien.

Les « nudify apps » accessibles sur smartphone ne requièrent aucune compétence technique, ce qui rend la limitation de l’exposition publique des photos d’enfants prioritaire.

Peut-on prouver qu’une vidéo est un deepfake devant un tribunal

C’est possible avec des analyses forensiques produites par des outils comme Sensity AI, mais la preuve reste complexe à établir.

Les juridictions françaises et européennes reconnaissent progressivement ces rapports comme éléments de preuve, et la jurisprudence est encore en construction dans la plupart des pays.

Qu’est-ce que le « dividende du menteur » lié aux deepfakes

C’est la stratégie consistant à invoquer l’existence des deepfakes pour nier une vraie vidéo compromettante : au fur et à mesure que la technologie se démocratise et que la méfiance publique grandit, des acteurs de mauvaise foi peuvent contester des preuves authentiques avec une crédibilité croissante auprès du grand public.

Articles Similaires

Reddit bloque le scraping IA : ce qui change pour les LLM et l’open source

Le 25 mars 2026, Reddit a déclenché une onde de choc dans la communauté IA : la plateforme ferme ses portes aux scrapers automatisés, impose la vérification biométrique pour les…

Jensen Huang déclare l’AGI atteinte : analyse d’une annonce qui divise

Le 22 mars 2026, à 1h55 dans l’épisode 494 du podcast Lex Fridman, Jensen Huang a prononcé cinq mots qui ont secoué la planète tech. Jensen Huang, PDG de Nvidia,…