Qu’est-ce que la distillation de modèles IA ?

La distillation de modèles est une technique qui consiste à transférer les connaissances d’un modèle IA puissant (le « professeur ») vers un modèle plus petit et plus économique (l’« élève »). L’objectif : obtenir des performances proches du modèle de pointe sur des tâches spécifiques, tout en réduisant drastiquement les coûts d’inférence et la latence. OpenAI a intégré cette technologie directement dans sa plateforme API avec la fonctionnalité Model Distillation.

En pratique, vous utilisez un modèle comme GPT-4o, o3 ou GPT-5 pour générer des réponses de haute qualité sur vos cas d’usage, puis vous fine-tunez un modèle plus petit comme GPT-4o mini avec ces exemples. Le résultat est un modèle spécialisé qui peut atteindre 90-95% de la qualité du modèle original à une fraction du coût.

La plateforme de distillation d’OpenAI en 2026

OpenAI propose un pipeline intégré de distillation directement dans sa plateforme, articulé autour de trois composants principaux :

Stored Completions : capture automatique des données

Les Stored Completions permettent de capturer et stocker automatiquement les paires entrée-sortie générées par vos appels API. Chaque requête envoyée à GPT-4o, o3 ou GPT-5 peut être sauvegardée comme donnée d’entraînement pour la distillation. C’est la base du pipeline : vous constituez un dataset de qualité simplement en utilisant l’API normalement sur vos cas d’usage réels.

Evals : évaluation et mesure de performance

Le système d’Evals intégré permet de créer des évaluations personnalisées pour mesurer la performance de vos modèles distillés sur des tâches spécifiques. Vous définissez des critères de qualité, des cas de test, et la plateforme vous donne des métriques précises sur la performance du modèle élève comparée au modèle professeur. C’est essentiel pour valider que la distillation a fonctionné avant de déployer en production.

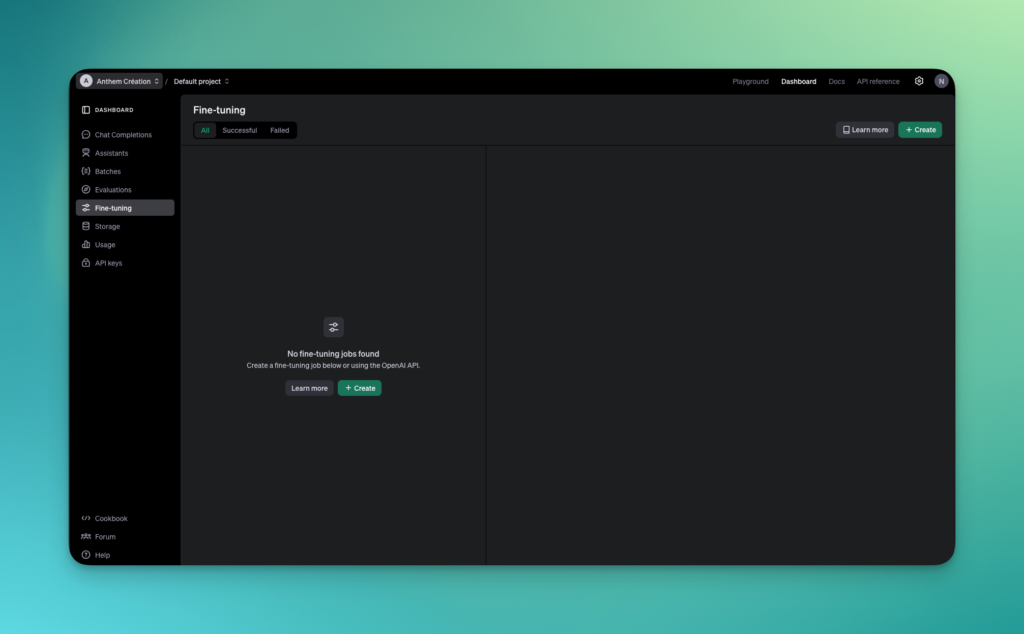

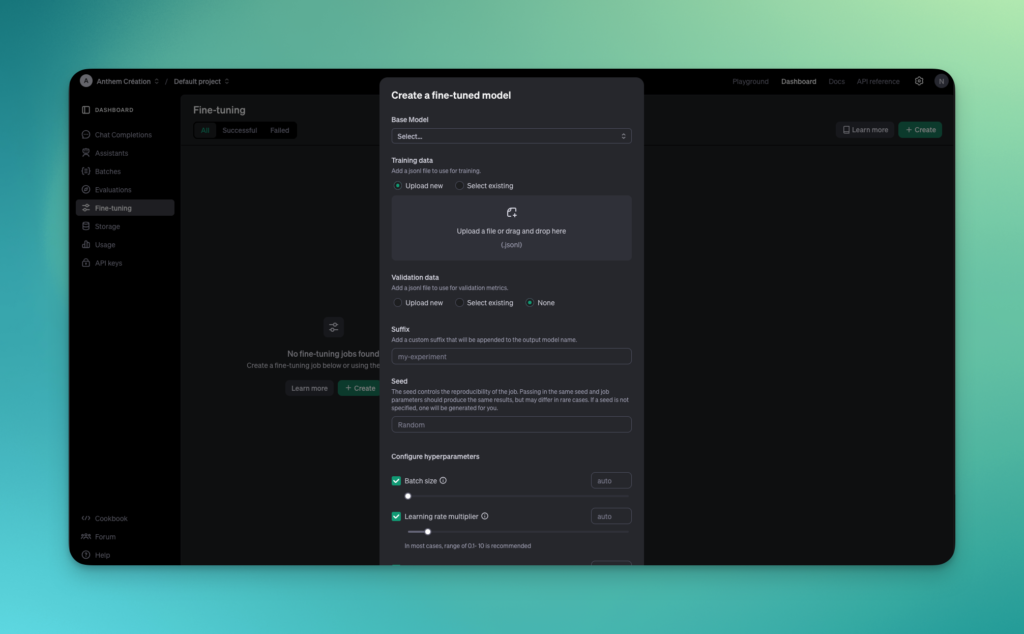

Fine-tuning intégré

Les Stored Completions et les Evals sont entièrement intégrés avec le système de fine-tuning d’OpenAI. Les datasets constitués via Stored Completions peuvent être directement utilisés dans des jobs de fine-tuning, et les modèles résultants peuvent être évalués avec Evals — le tout sans quitter la plateforme. OpenAI propose désormais plusieurs techniques de fine-tuning : le SFT (Supervised Fine-Tuning) classique, le DPO (Direct Preference Optimization) pour aligner les réponses sur les préférences humaines, et le RFT (Reinforcement Fine-Tuning) pour les tâches de raisonnement complexe.

Cas d’usage concrets de la distillation

La distillation trouve des applications dans de nombreux scénarios professionnels. Pour le support client, une entreprise peut utiliser GPT-5 pour générer des réponses parfaites à des milliers de tickets, puis distiller ces réponses dans un modèle GPT-4o mini qui répondra instantanément et à moindre coût. Pour l’extraction de données structurées, la classification de documents, ou la génération de contenu spécialisé, la distillation offre un excellent rapport qualité-coût.

Les startups et PME sont les principales bénéficiaires : elles peuvent accéder à une qualité proche des modèles de pointe sans le budget pour les utiliser en production à grande échelle. Un modèle distillé peut coûter 10 à 50 fois moins cher par requête que le modèle original, avec des temps de réponse significativement plus rapides.

Distillation vs. fine-tuning classique

La distillation diffère du fine-tuning traditionnel par la source des données d’entraînement. En fine-tuning classique, vous utilisez des données étiquetées manuellement par des humains. En distillation, les données proviennent d’un modèle plus puissant, ce qui est généralement plus rapide, moins coûteux, et produit des résultats plus cohérents car le « professeur » IA est plus constant qu’un groupe d’annotateurs humains.

Cependant, la distillation a ses limites. Le modèle élève ne peut pas dépasser les capacités du professeur — il ne fait que les approcher. Pour les tâches très complexes nécessitant un raisonnement profond, le modèle distillé montrera inévitablement des faiblesses que le modèle original ne présente pas. C’est pourquoi la stratégie optimale combine souvent les deux approches.

Comment démarrer avec la distillation

Pour commencer à distiller vos propres modèles via l’API OpenAI, activez d’abord les Stored Completions sur vos appels API en production. Accumulez au moins quelques centaines d’exemples de qualité, puis lancez un job de fine-tuning avec ces données. Utilisez les Evals pour mesurer la performance et itérez sur le dataset si nécessaire.

L’investissement en temps est modeste — quelques heures de configuration pour un processus qui peut ensuite tourner en continu. Le retour sur investissement est immédiat dès que votre volume d’appels API justifie l’effort : moins de coûts, moins de latence, et un modèle parfaitement adapté à vos besoins spécifiques.

Perspectives pour 2026

La distillation devient un pilier de la stratégie IA d’entreprise. Avec l’arrivée de modèles toujours plus puissants (GPT-5, o3) mais aussi plus coûteux, la capacité à distiller leur intelligence dans des modèles compacts et économiques est un avantage compétitif majeur. OpenAI continue d’améliorer sa plateforme avec de nouvelles techniques d’optimisation et une intégration plus poussée avec les outils de déploiement.

Pour approfondir les différences entre les modèles GPT, consultez notre comparatif détaillé qui vous aidera à choisir le bon modèle professeur et le bon modèle élève pour votre cas d’usage.

Articles Similaires

Obsidian Web Clipper : review du plugin officiel pour capturer le web en Markdown

Obsidian Web Clipper est sorti en version stable il y a un peu plus d’un an, et la question concrète pour un utilisateur Obsidian déjà installé n’a rien de marketing…

Plugins IA Obsidian 2026 : comparatif complet (Smart Connections, Copilot, Text Generator, AI Tagger, Companion, CAO)

Choisir parmi les plugins IA Obsidian en 2026 revient à arbitrer entre sept outils communautaires qui ne couvrent pas les mêmes besoins. Obsidian n’embarque toujours aucune intelligence artificielle native :…