Le 24 décembre 2025, pendant que l’industrie tech soufflait ses bougies de Noël, Nvidia annonçait le rachat de Groq pour 20 milliards de dollars.

Ce chiffre mérite qu’on s’arrête : en septembre 2025, Groq venait de boucler sa série D à 6,9 milliards de dollars de valorisation.

Trois mois plus tard, Nvidia a payé 2,9 fois ce montant pour mettre la main sur la startup spécialisée dans l’inférence ultra-rapide.

Ce n’est pas simplement un gros chèque : c’est le signal que la bataille de l’IA se joue désormais sur le terrain de l’inférence, et que les acteurs dominants savent exactement ce qu’ils achètent.

Ce qu’il faut retenir :

- Nvidia a payé 20 Md$ pour Groq, soit 2,9x sa valorisation de 6,9 Md$ trois mois plus tôt

- Le deal est structuré comme une licence non exclusive + acqui-hire pour contourner les régulateurs antitrust

- Le Groq 3 LPX livre 35x plus de tokens/s/MW que le Blackwell NVL72, grâce à une architecture SRAM radicalement différente

- GroqCloud facture aujourd’hui 0,59 $/M tokens contre 2,50 $/M pour GPT-4o : Vera Rubin promet encore 10x moins cher

- Le marché de l’inférence IA va passer de 106 à 255 Md$ entre 2025 et 2030

- Warren, Wyden et la FTC scrutent le deal : l’Europe aussi commence à s’interroger sur sa dépendance à Nvidia

Ce que Nvidia a réellement acheté

Une licence non exclusive, pas une acquisition classique

La structure du deal surprend au premier regard : Nvidia n’a pas acquis Groq directement.

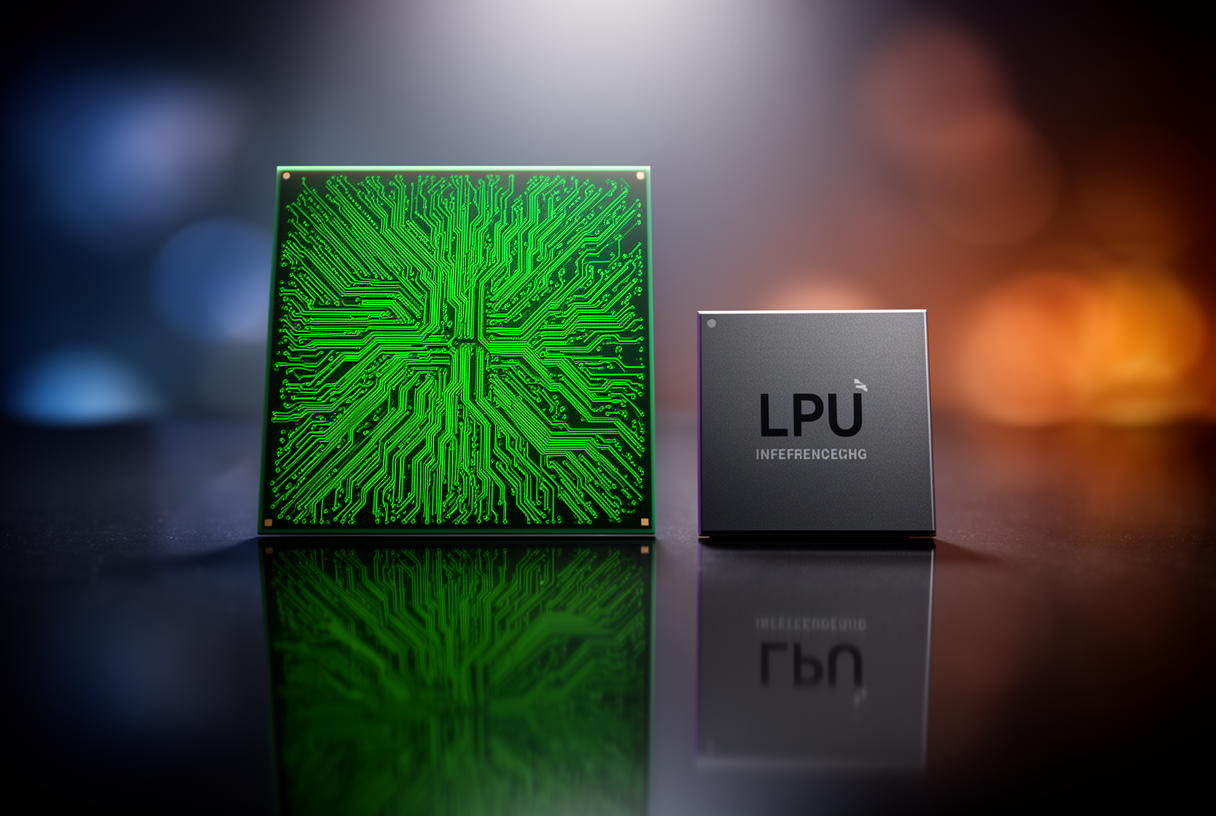

Le contrat prend la forme d’une licence non exclusive sur les technologies LPU (Language Processing Unit) de Groq, accompagnée d’un acqui-hire des fondateurs clés.

Ce montage n’est pas un hasard : avec 85 à 90 % de part de marché sur les accélérateurs IA de formation, Nvidia savait qu’une acquisition directe déclencherait immédiatement une enquête antitrust de la FTC et du DOJ.

La structure « licence non exclusive » est une fiction légale transparente : Groq conserve son existence juridique, mais la réalité opérationnelle ressemble trait pour trait à une acquisition complète.

Le précédent est parlant : en 2020, Nvidia avait tenté de racheter ARM Holdings pour 40 milliards de dollars et avait vu la transaction bloquée par les régulateurs après deux ans de procédures.

L’acqui-hire : là où réside la vraie valeur

Le second volet du deal est l’acqui-hire : Jonathan Ross (fondateur et ex-CTO) et Sunny Madra (président) rejoignent Nvidia.

Ross est l’architecte de la puce LPU, le cerveau derrière une approche qui remet en question trente ans de domination GPU.

Sans ses concepteurs originaux, Groq perd sa capacité à faire évoluer l’architecture vers les générations suivantes : la vraie valeur n’est pas dans les brevets, c’est dans la trajectoire R&D future, désormais domiciliée chez Nvidia.

Jensen Huang aurait pris sa décision en moins de trois semaines après qu’on lui ait présenté l’analogie suivante : former un modèle, c’est comme transporter des marchandises avec un camion 18 roues.

Faire tourner l’inférence, c’est faire de la livraison du dernier kilomètre à vélo : efficace, ciblé, et incomparablement moins coûteux par trajet.

Le Groq 3 LPX expliqué simplement

LPU vs GPU : une philosophie radicalement différente

Un GPU comme le Blackwell NVL72 de Nvidia est conçu pour traiter un maximum de calculs en parallèle : des milliers de cœurs, une hiérarchie de caches complexe, et un ordonnanceur dynamique qui décide en temps réel quelle tâche exécuter quand.

Cette flexibilité est une force pour l’entraînement des modèles, mais elle introduit une surcharge intrinsèque dès qu’on passe à l’inférence séquentielle.

Le LPU de Groq fait l’inverse : le compilateur décide à l’avance, au cycle d’horloge près, ce que chaque circuit fera et quand les données arriveront.

Résultat : zéro stall d’attente, zéro divergence de branche imprévisible, zéro faute de cache.

Sur les charges de travail de décodage token par token, cette exécution déterministe convertit une différence architecturale microscopique en avantage de latence mesurable en centaines de millisecondes par requête.

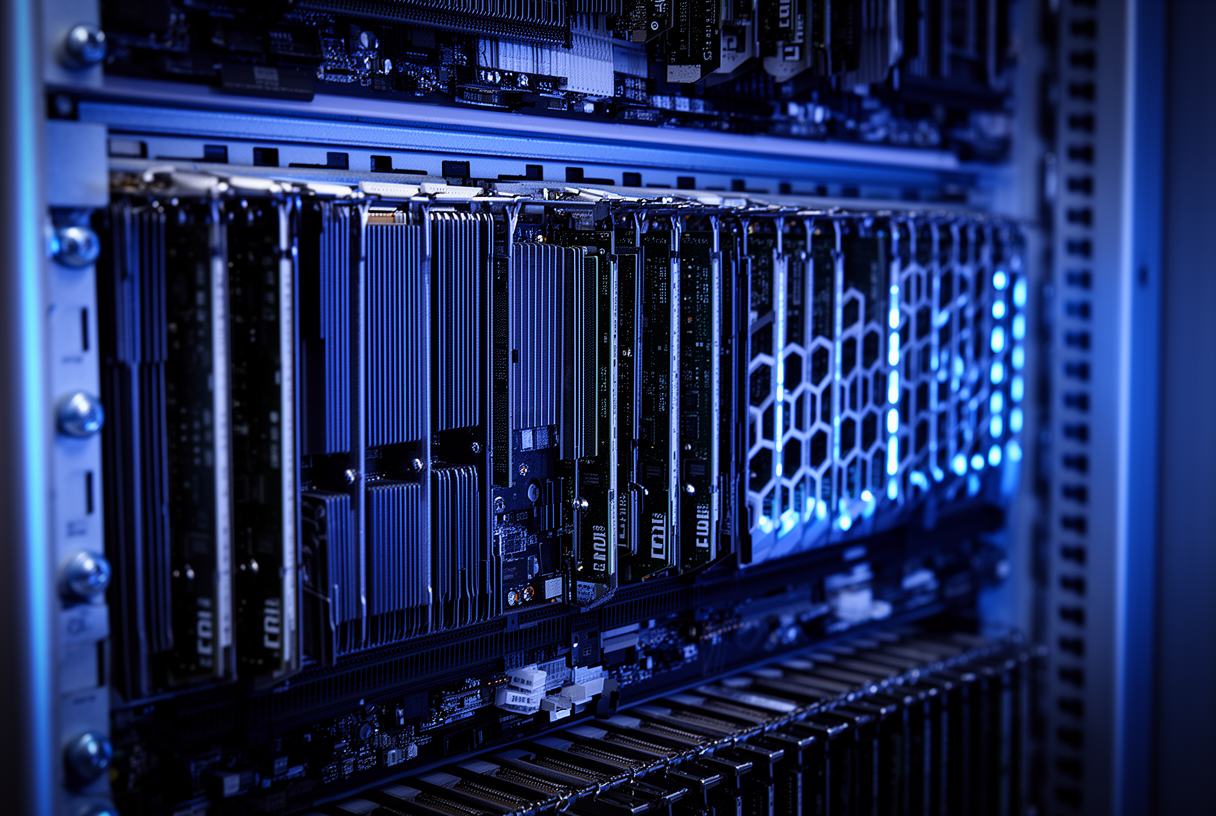

Architecture SRAM : 512 Mo par puce, 256 accélérateurs par rack

L’élément le plus distinctif du Groq 3 LPU est sa mémoire : chaque puce dispose de 512 Mo de SRAM haute vitesse utilisée comme stockage de travail primaire, là où les GPU comptent sur de la HBM externe.

La différence de latence est brutale : 1 nanoseconde pour accéder à la SRAM, contre 50 à 100 nanosecondes pour la HBM.

Le système Groq 3 LPX assemble 256 de ces LPUs interconnectés dans un rack unique, pour une capacité SRAM agrégée de 128 Go et une bande passante mémoire mondiale de 40 pétaoctets par seconde.

Chaque LPU se connecte via 96 liaisons C2C à 112 Gbps, permettant une synchronisation déterministe de l’ensemble des 256 unités comme si elles formaient un seul cœur.

Cerebras, concurrent direct de Groq, pousse cette logique encore plus loin avec 6x plus de SRAM, mais sur une architecture de wafer unique qui reste difficile à produire à grande échelle.

Prefill GPU + decode LPU : le duo gagnant

La phase de prefill traite l’intégralité du prompt d’entrée (parfois 50 000 tokens pour une analyse de code), une opération à haute intensité de calcul qui tolère une latence modérée.

La phase de decode génère les tokens de réponse un par un, de façon autorégressive : chaque token dépend des précédents, il est impossible de paralléliser, et la latence perçue par l’utilisateur dépend directement de cette vitesse.

La plateforme Vera Rubin hétérogène de Nvidia joue sur cette dualité : les GPU Rubin traitent le prefill computationnel, pendant que les LPUs Groq 3 du rack LPX prennent en charge le decode dominé par la mémoire.

L’orchestrateur Dynamo de Nvidia dirige automatiquement les tâches vers le bon matériel selon la taille du batch et les caractéristiques de la requête.

Le résultat revendiqué : 35x plus de débit par mégawatt pour les tâches d’inférence interactive, comparé au système Blackwell NVL72.

Ce chiffre concerne les modèles de trillion de paramètres en contexte interactif : les scénarios réels varieront selon la taille du modèle et le ratio prefill/decode, et la disponibilité commerciale du Groq 3 LPX reste à confirmer pour 2026.

Pour la première fois, une plateforme d’inférence n’est plus contrainte de choisir entre débit élevé et faible latence : Vera Rubin optimise les deux phases séparément sur le matériel le plus adapté à chacune.

Impact sur les prix : l’inférence 10x moins chère

Les tarifs GroqCloud face au marché

GroqCloud, la plateforme cloud de Groq pilotée par Simon Edwards depuis l’acquisition, affiche aujourd’hui des tarifs qui redéfinissent les attentes du secteur.

Llama 3.3 70B sur GroqCloud coûte 0,59 $/million de tokens d’entrée et 0,79 $/M tokens de sortie, soit une moyenne de 0,69 $/M tokens.

GPT-4o facture 2,50 $/M tokens d’entrée et 10,00 $/M tokens de sortie : l’écart atteint un facteur 18x sur le coût brut par token pour des performances comparables.

Ces écarts reflètent une réalité structurelle : les LPU produisent plus de tokens par watt, ce qui réduit mécaniquement le coût d’exploitation.

Vera Rubin promet encore 10x de réduction

Nvidia avance un objectif de 45 $/M tokens pour Vera Rubin + LPX en production de modèles de trillion de paramètres, ce qui représente environ 10x moins cher que les prix Blackwell actuels pour ces modèles.

Pour les modèles de 70B paramètres, les projections de coût 10x inférieur à Blackwell suggèrent une fourchette de 0,10 à 0,20 $/M tokens, niveau compétitif avec les meilleurs prix actuels du marché.

Le marché de l’inférence IA était évalué à 106 milliards de dollars en 2025 : les projections pour 2030 atteignent 255 milliards de dollars, soit un CAGR de 19,2 %.

Calcul concret : votre agent IA aujourd’hui vs demain

Prenons un cas réel : une entreprise gérant 100 000 tickets de support client par mois via un agent IA basé sur GPT-4o.

Chaque ticket mobilise en moyenne 2 000 tokens en entrée et 500 tokens en sortie : soit 250 millions de tokens par mois.

Au tarif GPT-4o actuel (2,50 $/M entrée + 10 $/M sortie), la facture mensuelle atteint 5 625 dollars : 625 $ pour l’entrée, 5 000 $ pour la sortie.

Sur GroqCloud avec Llama 3.3 70B, le même volume tombe à 670 dollars par mois : une économie de 88 %.

Avec Vera Rubin à 10x moins cher que Blackwell, cette facture pourrait descendre sous les 200 dollars par mois pour un volume identique.

À ce niveau de coût, des cas d’usage qui n’étaient pas rentables à opérer à grande échelle le deviennent : agents de relance proactive, analyse systématique de tous les tickets, résumés automatisés pour chaque interaction.

L’IA d’inférence bon marché ne réduit pas les budgets : elle multiplie les usages que les budgets existants peuvent financer.

La riposte des concurrents

Le rachat de Groq accélère une tendance que les hyperscalers avaient déjà anticipée : réduire leur dépendance aux GPU Nvidia en développant leurs propres puces.

AMD joue la carte de l’architecture GPU avec sa série MI350 (35x d’amélioration inférence vs génération précédente) et prépare la MI400 en 2026 sur processus 2 nm avec 432 Go de HBM4.

Google continue l’évolution de ses TPU avec Ironwood (7ème génération), capable de synchroniser jusqu’à 9 216 unités via commutation optique, mais l’accès reste limité à Google Cloud.

Microsoft intègre son accélérateur Maia 100 (TSMC 3nm, 10 PFLOPS FP4, 216 Go HBM3e) en parallèle des GPU Blackwell dans Azure, une stratégie multi-fournisseur assumée.

Amazon avance avec Trainium3 et Inferentia, déjà utilisés en interne pour réduire les coûts d’AWS Bedrock.

La menace commune : ces puces maison ne bénéficient pas de l’environnement CUDA, qui reste l’avantage compétitif le plus difficile à répliquer pour Nvidia.

Pour en savoir plus sur les annonces Nvidia de cette période, notre analyse de la conférence GTC 2026 et les agents Feynman et OpenClaw détaille le contexte stratégique complet.

Antitrust et souveraineté : les vraies questions

En février 2026, les sénateurs Elizabeth Warren et Ron Wyden ont adressé une lettre formelle à Jensen Huang, interrogeant la structure antitrust de la transaction.

Leur argument : une entreprise contrôlant 85 à 90 % des accélérateurs IA de formation qui acquiert la technologie d’inférence la plus prometteuse du marché via une fiction juridique de licence constitue une consolidation effective de la chaîne de valeur IA.

Le parallèle avec l’acquisition d’ARM tentée pour 40 Md$ en 2020 est explicite dans leur courrier : si la transaction avait réussi, Nvidia aurait contrôlé l’architecture de base utilisée par tous ses concurrents.

La Commission européenne a ouvert un examen préliminaire des partenariats datacenter de Nvidia en novembre 2025, avant même l’annonce Groq.

La question de souveraineté numérique devient concrète : si l’inférence IA mondiale transite demain par des infrastructures LPU contrôlées par Nvidia, les entreprises françaises et européennes dépendent d’une décision commerciale américaine pour maintenir l’accès à leurs propres agents IA.

Mistral, qui vient de renforcer son positionnement souveraineté, incarne précisément cette alternative : une chaîne d’inférence européenne ne peut fonctionner à grande échelle sans un accès au matériel qui n’oblige pas à passer par un guichet unique américain.

Savoir lire les performances réelles des puces dans les benchmarks publiés permet de distinguer les revendications marketing des gains réels : notre guide pour lire les benchmarks IA sans se faire manipuler donne les clés pour évaluer les chiffres Nvidia et Groq en contexte.

Ce que ça change pour vous

Il redessine l’économie de l’IA générative sur les 24 à 36 prochains mois.

Les coûts d’inférence vont continuer à baisser structurellement : les acteurs qui ont construit leur business model sur des marges élevées liées au coût du token vont subir une pression croissante.

Les acteurs qui ont investi dans des workflows d’agents IA vont voir leurs coûts d’exploitation fondre, rendant rentables des automatisations qui ne l’étaient pas à 2,50 $/M tokens.

La contrainte qui va limiter l’accélération n’est plus le prix : elle sera la qualité des données, la fiabilité des orchestrations, et la gouvernance des décisions automatisées.

Si vous cherchez à quantifier les économies accessibles sur vos propres workloads d’inférence, contactez-nous pour auditer vos coûts et identifier les migrations possibles vers les nouvelles architectures.

FAQ

Pourquoi Nvidia a-t-il payé 20 Md$ alors que Groq était valorisé 6,9 Md$ 90 jours avant ?

La prime de 2,9x reflète la valeur stratégique d’éliminer un concurrent technologique avant qu’il ne s’impose sur le marché de l’inférence : Nvidia a préféré payer cher rapidement plutôt que de laisser Groq capturer ce marché.

Qu’est-ce qu’un LPU et en quoi est-ce différent d’un GPU ?

Un LPU (Language Processing Unit) est conçu exclusivement pour l’inférence séquentielle : le compilateur planifie à l’avance chaque opération, éliminant les temps d’attente dynamiques des GPU et permettant une génération de tokens beaucoup plus rapide et prévisible.

Le Groq 3 LPX est-il disponible commercialement aujourd’hui ?

La disponibilité commerciale du Groq 3 LPX intégré à Vera Rubin reste à confirmer : les performances annoncées (35x tokens/s/MW) sont des projections pour des déploiements en datacenter que Nvidia prépare pour 2026, avec une mise en production progressive.

Qu’est-ce que la plateforme Vera Rubin hétérogène ?

Vera Rubin est la prochaine génération de plateforme d’inférence Nvidia qui combine des GPU Rubin pour le prefill (traitement du prompt) et des LPUs Groq 3 pour le decode (génération des tokens), chaque phase étant traitée par le matériel le plus adapté.

Combien coûte réellement l’inférence sur GroqCloud ?

Llama 3.3 70B sur GroqCloud coûte 0,59 $/M tokens en entrée et 0,79 $/M en sortie, soit 18 fois moins cher que GPT-4o pour un niveau de performance similaire sur des tâches standards.

Warren et Wyden ont-ils bloqué le deal ?

Non : leur lettre de février 2026 représente une interpellation politique sans pouvoir de blocage direct.

La FTC et le DOJ mènent des enquêtes distinctes, mais le montage en licence non exclusive réduit la surface juridique d’une contestation antitrust classique.

Cerebras est-il une meilleure alternative à Groq ?

Cerebras dispose de 6 fois plus de SRAM que le LPU de Groq, ce qui lui donne un avantage théorique sur les modèles très volumineux, mais son architecture de wafer unique reste plus difficile à produire et à mettre à l’échelle en datacenter que la solution modulaire de Groq.

Les entreprises françaises doivent-elles s’inquiéter de la consolidation Nvidia-Groq ?

La concentration croissante de l’infrastructure d’inférence IA dans une seule infrastructure américaine pose une question de dépendance réelle : une alternative souveraine crédible nécessite à la fois des modèles ouverts (Mistral, Llama) et un accès à des infrastructures de calcul non contrôlées par un acteur unique.

AMD ou les puces maison des hyperscalers peuvent-ils contrer Nvidia après Groq ?

AMD progresse avec la MI400 en 2026 et les hyperscalers investissent dans Trainium, Maia et TPU, mais aucun n’a encore l’environnement logiciel CUDA d’Nvidia ni la combinaison GPU/LPU que Vera Rubin apporte pour l’inférence interactive.

Le coût d’inférence va-t-il baisser de 10x ?

Les projections Nvidia de 10x de réduction sur Blackwell sont crédibles sur les modèles de très grande taille et les déploiements à large échelle, mais la réduction effective dépendra du modèle utilisé, du ratio prefill/decode de vos workloads, et des délais de disponibilité commerciale réels du Groq 3 LPX.

Articles Similaires

Reddit bloque le scraping IA : ce qui change pour les LLM et l’open source

Le 25 mars 2026, Reddit a déclenché une onde de choc dans la communauté IA : la plateforme ferme ses portes aux scrapers automatisés, impose la vérification biométrique pour les…

Jensen Huang déclare l’AGI atteinte : analyse d’une annonce qui divise

Le 22 mars 2026, à 1h55 dans l’épisode 494 du podcast Lex Fridman, Jensen Huang a prononcé cinq mots qui ont secoué la planète tech. Jensen Huang, PDG de Nvidia,…