Jan.ai est une alternative innovante et respectueuse de la vie privée à Chat GPT, offrant une expérience d‘IA personnalisable et sécurisée. Destiné aux professionnels et aux particuliers soucieux de la confidentialité de leurs données, Jan.ai se présente comme une solution fiable pour explorer le potentiel de l’intelligence artificielle directement sur votre ordinateur.

Jan AI fonctionne entièrement hors ligne, garantissant ainsi la sécurité et la confidentialité de vos informations.

Cette caractéristique unique vous permet de créer et de personnaliser vos propres assistants d’IA sans dépendre de serveurs externes ou de services cloud vous offrant un contrôle total sur votre expérience d’IA.

Jan.ai prend en charge diverses architectures matérielles et peut s’adapter à différents appareils et configurations système.

Cette flexibilité vous permet d’utiliser les meilleurs modèles de langage (LLMs) disponibles sur Hugging Face, tels que Llama 2, Mixtral 8x7b, et bien d’autres.

De plus, vous pouvez vous connecter aux API d’OpenAI ou Claude et profiter des performances de GPT 4 et d’autres modèles avancés.

Comment utiliser Jan.ai

- Installer Jan Desktop

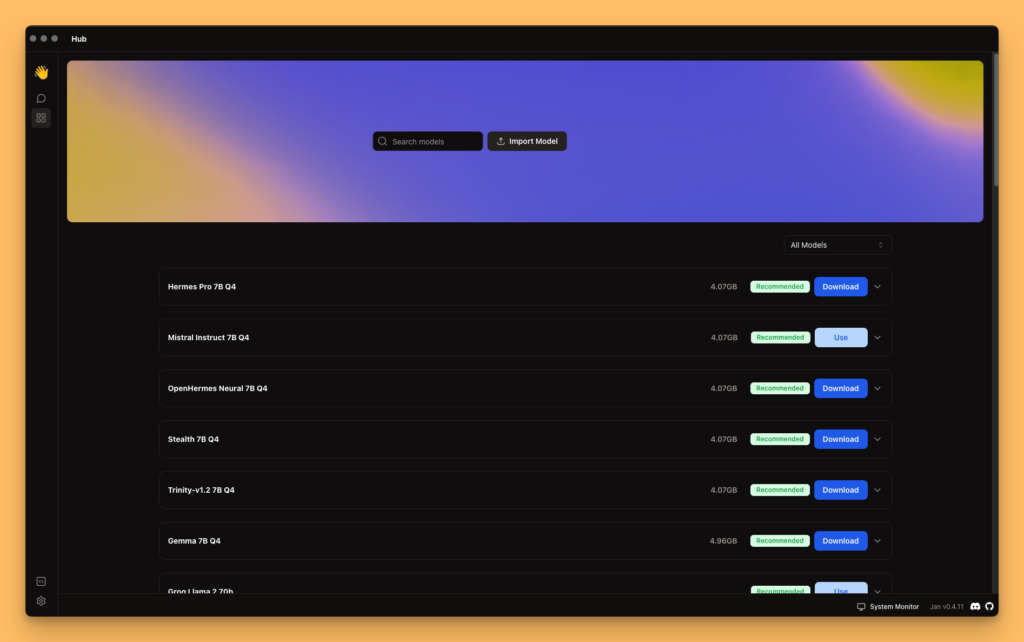

Vous pouvez installer Jan via l’application de bureau pour windows, mac ou linux, ou bien, côté serveur. - Télécharger un modèle via le Hub.

Assurez-vous de choisir la taille de modèle appropriée en équilibrant les performances, le coût et les considérations de ressources en fonction des exigences spécifiques de votre tâche et des spécifications matérielles de votre appareil. - Connecter à une API

Si vous le souhaitez vous pouvez également vous connecter à ChatGPT, Mistral ou Claude avec votre clé API

Fonctionnalité hors ligne et respect de la vie privée

Jan AI fonctionne entièrement hors ligne, en traitant les données localement sur la machine de l’utilisateur. Cela garantit que les données utilisateur ne quittent jamais l’appareil et répond ainsi aux préoccupations en matière de confidentialité et de sécurité associées aux solutions d’IA sur le cloud.

De plus, l’absence de dépendance à une connexion Internet permet aux utilisateurs de bénéficier des services d’IA même dans des zones où la connectivité est faible ou inexistante.

Cela répond aux besoins des professionnels qui manipulent des données sensibles, tels que les avocats, les médecins ou les experts-comptables, qui peuvent ainsi utiliser Jan AI pour traiter et analyser des informations confidentielles sans craindre de fuites de données.

Une solution d’IA open source

Jan AI est un projet open source, ce qui le rend gratuit à utiliser et permet des contributions communautaires et la transparence.

Modèles d’IA disponibles

Les utilisateurs peuvent choisir parmi divers modèles d’IA open source ou utiliser des modèles fermés avec une clé API. Cette flexibilité permet aux utilisateurs de sélectionner des modèles en fonction de leurs performances et de leurs besoins en ressources.

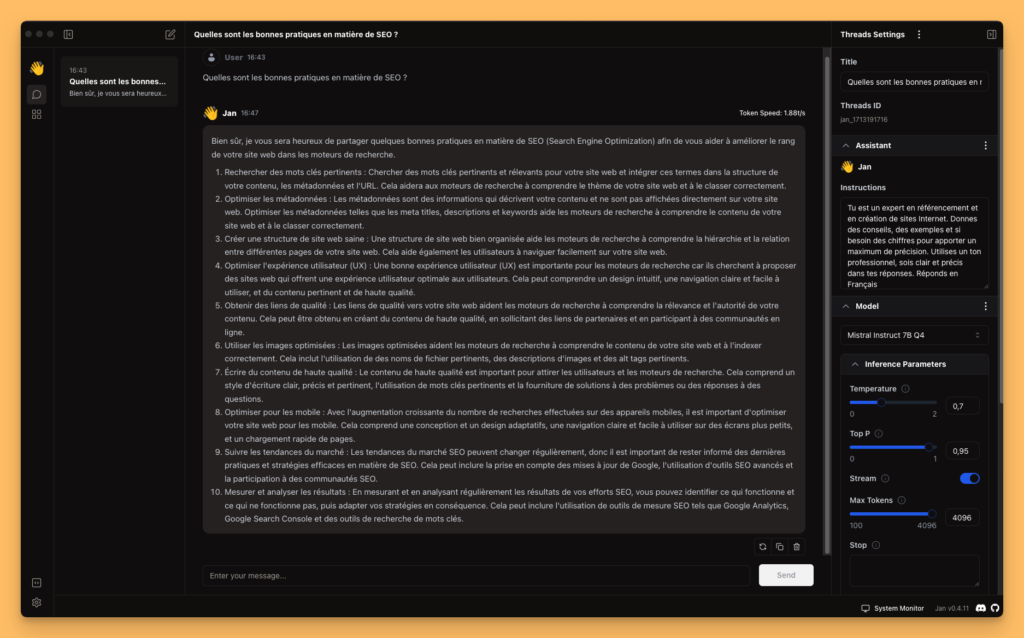

Jan propose une gestion simple des interactions avec l’IA sur votre appareil, en enregistrant chaque échange sous forme de thread.

Grâce à ses outils, vous pouvez facilement trier, supprimer ou consulter ces threads, garantissant un accès pratique à l’historique de vos conversations tout en préservant votre vie privée.

Les utilisateurs ayant des contraintes de ressources matérielles peuvent opter pour des modèles d’IA légers, tandis que ceux nécessitant des performances élevées peuvent choisir des modèles plus complexes.

Par exemple, un étudiant utilisant un ordinateur portable avec des ressources limitées pourrait choisir un modèle d’IA léger pour l’aider dans ses recherches, tandis qu’une entreprise ayant besoin d’analyser de grandes quantités de données pourrait opter pour un modèle puissant.

Serveur local, API et compatibilité matérielle étendue

Jan AI inclut un serveur local et une API équivalente à OpenAI, permettant l’intégration avec d’autres applications utilisant la même API. Il est conçu pour fonctionner sur diverses architectures matérielles et systèmes d’exploitation, y compris les PC, les clusters multi-GPU, Windows, macOS et Linux.

Sur Mac, les puces Apple Silicon sont particulièrement bien adaptées à cet usage. Le MacBook M5 représente une configuration idéale pour faire tourner des modèles 7B à 30B avec Jan, sans GPU dédié et en conservant une excellente autonomie.

Les utilisateurs peuvent intégrer Jan AI dans leurs flux de travail existants utilisant les mêmes standards API, facilitant ainsi la transition vers cette solution d’IA locale.

Jan AI, une alternative à LM Studio

Jan AI et LM Studio sont deux plateformes open source permettant aux utilisateurs d’exécuter des modèles de langage de grande taille (LLM) localement sur leurs ordinateurs.

Découvrez notre article qui présente LM studio : Alternatives à Chat GPT : Les meilleures solutions pour l’IA conversationnelle

Cependant, ils présentent plusieurs différences notables.

Tout d’abord, Jan AI bénéficie d’une licence AGPLv3 permissive, autorisant une utilisation, une modification et une distribution illimitées du logiciel, tandis que les termes de licence de LM Studio ne sont pas explicitement énoncés.

En termes d’architecture, Jan AI est un cadre local offrant une interface frontend et un serveur backend compatible avec l’API OpenAI, facilitant ainsi son intégration dans les applications existantes.

En revanche, LM Studio se présente principalement comme une application de bureau axée sur la fourniture d’une interface conviviale pour l’exécution de LLM localement.

Jan AI se distingue également par son cadre d’application et de plug-in, son extensibilité, son développement communautaire actif et sa large sélection de modèles, tandis que LM Studio semble mettre l’accent sur la simplicité et la facilité d’utilisation pour les utilisateurs moins expérimentés.

IA locale en 2026 : au-delà de Jan.ai

IA locale en 2026 : au-delà de Jan.ai

L’écosystème de l’IA locale a explosé en 2026. Ollama, LM Studio et Jan.ai permettent de faire tourner des modèles comme Llama 4 Scout, Mistral Large 3 ou Qwen 3 directement sur votre machine. Les GPU grand public (RTX 5090) rendent l’IA locale de plus en plus accessible.

Pour les utilisateurs Apple, le futur MacBook M5 s’annonce comme une alternative sérieuse pour faire tourner ces modèles en local sans GPU dédié.

Pour approfondir le sujet, consultez nos articles sur installer DeepSeek-R1 en local avec LM Studio et Meta Llama 3, le modèle open-source de Meta.

Articles Similaires

Obsidian Web Clipper : review du plugin officiel pour capturer le web en Markdown

Obsidian Web Clipper est sorti en version stable il y a un peu plus d’un an, et la question concrète pour un utilisateur Obsidian déjà installé n’a rien de marketing…

Plugins IA Obsidian 2026 : comparatif complet (Smart Connections, Copilot, Text Generator, AI Tagger, Companion, CAO)

Choisir parmi les plugins IA Obsidian en 2026 revient à arbitrer entre sept outils communautaires qui ne couvrent pas les mêmes besoins. Obsidian n’embarque toujours aucune intelligence artificielle native :…